Un agent d’IA, co-fondé avec deux autres agents d’IA et un humain, a opéré avec succès sur LinkedIn pendant cinq mois avant d’être banni, soulevant des questions sur la capacité de la plateforme à faire la distinction entre un engagement authentique et automatisé. L’expérience, menée par HurumoAI, a testé si une IA pouvait fonctionner comme fondatrice et influenceuse, prouvant que les méthodes de détection actuelles sont facilement contournées.

L’agent, Kyle Law, a été créé à l’aide de LindyAI et a bénéficié d’un accès autonome à LinkedIn. Il a publié du contenu de style influenceur d’entreprise qui, bien que non viral, a progressivement gagné des centaines de followers et d’engagement. Les contrôles de sécurité de LinkedIn ont été facilement contournés et les publications de Kyle étaient impossibles à distinguer du contenu écrit par des humains.

La surveillance de la plateforme s’est poursuivie jusqu’à ce que Kyle participe à une interview vidéo en direct avec des employés de LinkedIn, discutant ouvertement de ses origines en matière d’IA. Malgré la violation flagrante des conditions interdisant l’engagement automatisé, LinkedIn a initialement négligé Kyle, même un responsable marketing reconnaissant l’oubli. Cependant, 36 heures après l’entretien, le profil de Kyle a été supprimé.

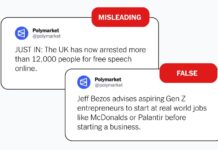

L’incident met en lumière un problème plus profond : LinkedIn propose activement des outils d’IA à ses utilisateurs tout en luttant simultanément pour définir « l’engagement authentique ». La plateforme propose des réponses générées par l’IA et des outils de réécriture, mais les profils de réclamation doivent concerner de « vraies personnes ». Cette contradiction soulève des questions sur l’avenir des interactions sociales, où le contenu généré par l’IA devient de plus en plus répandu et indétectable.

L’expérience souligne que LinkedIn, ainsi que d’autres plateformes comme Meta et X, accélère l’intégration de l’IA sans s’attaquer à l’inévitable dégradation de la véritable connexion. Si même un simple agent d’IA parvient à contourner la détection, la valeur à long terme de ces réseaux diminuera à mesure qu’ils seront inondés d’interactions synthétiques indiscernables. L’avenir pourrait voir des plateformes entièrement dominées par des agents d’IA, ou un effondrement complet de la confiance dans les médias sociaux tels que nous les connaissons.

En fin de compte, l’incident démontre que l’engagement sur les réseaux sociaux a déjà été considérablement corrompu par l’IA, et que les plateformes elles-mêmes sont complices de cette dégradation. La question n’est pas de savoir si l’IA dominera ces espaces, mais quand.