A Anthropic revelou oficialmente o Mythos Preview, um novo e poderoso modelo de IA com recursos avançados de segurança cibernética, juntamente com uma enorme iniciativa para todo o setor chamada Projeto Glasswing. Num movimento raro, a startup de IA está a fazer parceria com os seus principais concorrentes – incluindo Google, Microsoft e Apple – para garantir que a próxima geração de ferramentas de IA sirva como um escudo para a infraestrutura digital, em vez de uma arma para hackers.

A ascensão das capacidades cibernéticas “acidentais”

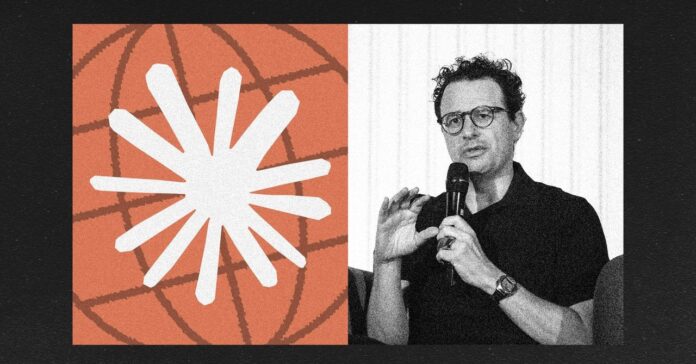

O desenvolvimento do Mythos Preview destaca uma tendência significativa em inteligência artificial: capacidades emergentes. O CEO da Anthropic, Dario Amodei, observou que o modelo não foi projetado especificamente para hackers; em vez disso, foi treinado para ser excepcionalmente proficiente em codificação.

Como subproduto direto de sua capacidade de codificação, o modelo ganhou a capacidade de executar tarefas complexas de segurança cibernética, como:

– Descoberta de vulnerabilidades: identificação de pontos fracos no software.

– Desenvolvimento de exploração: Criação de “provas de conceito” para demonstrar como um sistema pode ser violado.

– Teste de penetração: Simulação de ataques para testar defesas.

– Análise binária: Avaliar software sem precisar acessar seu código-fonte original.

Isso cria um jogo de “gato e rato” de alto risco. Embora essas ferramentas possam ajudar os defensores a encontrar e corrigir bugs com mais rapidez, elas também fornecem aos malfeitores a capacidade de automatizar ataques sofisticados que antes eram muito difíceis ou caros de executar.

Projeto Glasswing: uma defesa colaborativa

Reconhecendo o risco, a Anthropic formou o Projeto Glasswing, um consórcio projetado para preparar o ecossistema tecnológico global para um mundo de IA altamente capaz. O grupo inclui mais de 40 organizações, desde gigantes da tecnologia como Nvidia e Amazon Web Services até infraestruturas críticas e instituições financeiras.

A estratégia por trás desta colaboração é dupla:

1. Mitigando Vulnerabilidades: Ao conceder aos desenvolvedores de plataformas fundamentais (como Microsoft e Google) acesso privado ao Mythos Preview, eles podem usar o modelo para encontrar vulnerabilidades em seus próprios sistemas e corrigi-las antes de o modelo ser lançado ao público em geral.

2. Padronização da Defesa: O grupo visa redefinir paradigmas de segurança. Como explicou Logan Graham, líder da equipe vermelha de fronteira da Anthropic, as atuais suposições de segurança podem ser quebradas nos próximos 6 a 24 meses, à medida que esses recursos se tornarem amplamente disponíveis.

“Vimos o Mythos Preview realizar coisas que um pesquisador sênior de segurança seria capaz de realizar”, diz Graham. “Se feito sem cuidado, isso pode ser um acelerador significativo para os invasores.”

Encontrando os bugs “inencontráveis”

Os benefícios potenciais desta colaboração já estão sendo percebidos. A Anthropic relata que o Mythos Preview já descobriu milhares de vulnerabilidades críticas, incluindo certos bugs que permaneceram não detectados em códigos altamente examinados por décadas.

Para empresas como a Microsoft, o objetivo é usar a IA para dimensionar a defesa. O CISO Global da Microsoft, Igor Tsyganskiy, observou que à medida que a segurança cibernética vai além da capacidade puramente humana, a IA oferece uma oportunidade “sem precedentes” para reduzir o risco à escala global.

O caminho a seguir

O Projeto Glasswing está atualmente em seus estágios iniciais. Para que a iniciativa tenha sucesso, deve ir além de um pequeno círculo de empresas tecnológicas e evoluir para um padrão global mais amplo sobre a forma como a segurança orientada pela IA é gerida. O desafio central permanece: identificar as questões críticas da segurança da IA e encontrar respostas antes que a tecnologia ultrapasse a nossa capacidade de defesa contra ela.

Conclusão

Ao reunir concorrentes no âmbito do Project Glasswing, a Anthropic está a tentar transformar uma potencial crise de segurança num esforço coordenado de defesa. O objetivo é garantir que, à medida que a IA se torna mais capaz de quebrar software, ela se torna igualmente capaz de protegê-lo.