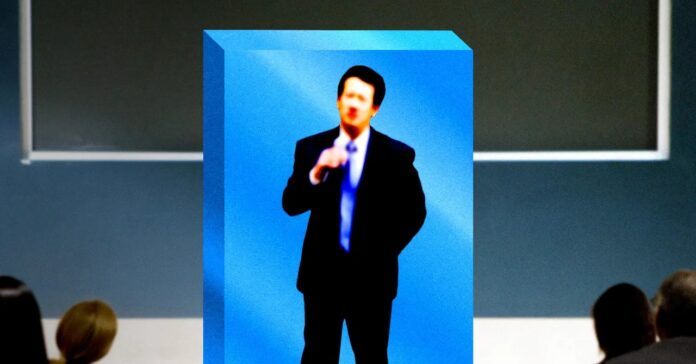

AI-агент, заснований спільно з двома іншими AI-агентами та людиною, успішно працював у LinkedIn протягом п’яти місяців, перш ніж його заблокували, що ставить під питання здатність платформи розрізняти справжню та автоматизовану взаємодію. Експеримент, проведений HurumoAI, перевірив, чи AI може функціонувати як засновник і впливова людина, довівши, що поточні методи виявлення легко обходяться.

Агент, Кайл Ло, був створений за допомогою LindyAI і отримав автономний доступ до LinkedIn. Він публікував контент у стилі корпоративного інфлюєнсера, який, хоч і не став вірусним, стабільно набирав сотні передплатників та залученість. Перевірки безпеки LinkedIn були легко обійдені, і повідомлення Кайла не відрізнялися від контенту, написаного людиною.

Нагляд платформи продовжувався доти, доки Кайл не взяв участь у прямому відеоінтерв’ю із співробітниками LinkedIn, відкрито обговоривши своє походження в AI. Незважаючи на явне порушення умов, що забороняють автоматизовану взаємодію, LinkedIn спочатку проігнорував Кайла, причому навіть менеджер з маркетингу визнав недогляд. Однак через 36 годин після інтерв’ю профіль Кайла було видалено.

Цей інцидент підкреслює глибшу проблему: LinkedIn активно просуває AI-інструменти для своїх користувачів, одночасно намагаючись визначити, що таке “справжня взаємодія”. Платформа пропонує AI-генеровані відповіді та інструменти перефразування, але стверджує, що профілі повинні належати “реальним людям”. Ця суперечність ставить під питання майбутнє соціальної взаємодії, де AI-генерований контент стає все більш поширеним і невиявленим.

Експеримент наголошує, що LinkedIn, поряд з іншими платформами, такими як Meta та X, прискорює інтеграцію AI, не вирішуючи неминучу деградацію справжніх зв’язків. Якщо навіть базовий AI-агент може обійти виявлення, довгострокова цінність цих мереж зменшиться, оскільки вони будуть затоплені синтетичними взаємодіями. У майбутньому платформи можуть бути повністю захоплені AI-агентами, або станеться повний крах довіри до соціальних мереж у тому вигляді, як ми їх знаємо.

Кінець кінцем, цей інцидент демонструє, що соціальна взаємодія вже значно спотворена AI, і самі платформи причетні до цієї деградації. Питання не в тому, чи домінує AI у цих просторах, а коли це станеться.